Новое поколение Embedding-моделей: революция в семантическом поиске

Новое поколение Embedding-моделей: революция в семантическом поиске

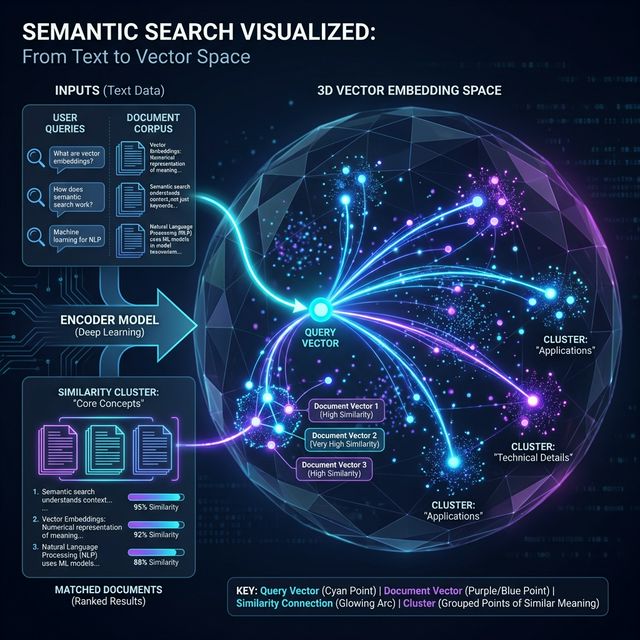

Февраль 2026 года ознаменовался настоящим прорывом в области моделей эмбеддингов. Новое поколение решений кардинально превосходит устаревшие BERT-модели по всем ключевым параметрам: длина контекста, качество понимания инструкций и производительность на русском языке.

🚀 Ключевые игроки рынка

GigaEmbeddings от Sber AI Sage

Российская модель GigaEmbeddings стала настоящим прорывом для работы с русскоязычным контентом. Построенная на базе GigaChat, она демонстрирует state-of-the-art результаты на 23 задачах из бенчмарка ruMTEB.

Ключевые преимущества:

- 🎯 Оптимизирована для русского языка и культурного контекста

- 💪 Производительность ~69.1 на ruMTEB

- 🔧 Вдвое меньше весит, чем конкуренты

- 🏠 Работает на потребительском железе

Qwen3-Embedding Series от Alibaba

Китайская серия Qwen3-Embedding (0.6B, 4B, 8B) представляет собой универсальное решение для мультиязычных задач с поддержкой более 100 языков.

Технические характеристики:

| Модель | Параметры | ruMTEB Score | Контекст |

|---|---|---|---|

| Qwen3-Embedding-8B | 8B | ~70.6 | 32K токенов |

| Qwen3-Embedding-4B | 4B | ~69.5 | 32K токенов |

| Qwen3-Embedding-0.6B | 0.6B | ~65+ | 8K токенов |

Другие перспективные решения

EmbeddingGemma-300M (Google DeepMind)

- Легковесная модель для edge-устройств

- Поддержка 100+ языков

- Оптимизирована для on-device развертывания

BAAI BGE-M3

- Топовая open-source модель

- Гибридный поиск (лексический + семантический)

- Поддержка 100+ языков

Nomic Embed Text V2

- Архитектура Mixture-of-Experts (MoE)

- Эффективная обработка длинных текстов

- ~100 языков

🔄 Архитектурная революция: от BERT к Decoder-Only

Главное отличие нового поколения — переход от энкодеров BERT к архитектуре decoder-only:

Было (BERT):

# Ограничение контекста

max_tokens = 512 # Критическое ограничение!

# Потеря информации при длинных текстах

long_document = split_into_chunks(document, max_length=512)

embeddings = [model.encode(chunk) for chunk in long_document]

# ❌ Теряется контекст между частямиСтало (Decoder-Only):

# Огромный контекст без потерь

max_tokens = 32000 # 64x больше!

# Обработка целого документа

embedding = model.encode(long_document)

# ✅ Полный контекст сохраненПонимание инструкций

Новые модели понимают естественные команды:

from sentence_transformers import SentenceTransformer

model = SentenceTransformer("Alibaba-NLP/gte-Qwen3-embedding-8B")

# Задача: семантический поиск

query_embedding = model.encode(

"Найди документы о настройке интеграции 1С с внешними системами",

prompt_name="query" # Указываем тип задачи

)

# Задача: классификация

doc_embedding = model.encode(

document_text,

prompt_name="classification" # Та же модель, другая задача!

)📊 Сравнение производительности

Результаты на русскоязычном бенчмарке ruMTEB:

| Модель | Средний Score | Размер | Контекст |

|---|---|---|---|

| Qwen3-Embedding-8B | 70.6 | 8B | 32K |

| GigaEmbeddings | 69.1 | 4B | 4K |

| Qwen3-Embedding-4B | 69.5 | 4B | 32K |

| multilingual-e5-large | 65.5 | 560M | 512 |

| KaLM-Embedding-V2 | 58-64 | - | - |

🎯 Выбор модели для вашей задачи

Для работы с русским языком:

Рекомендация: GigaEmbeddings

- Лучшее понимание российских реалий

- Компактный размер

- Отличная производительность

Для мультиязычных проектов:

Рекомендация: Qwen3-Embedding-4B/8B

- Поддержка 100+ языков

- Огромный контекст (32K)

- Топовая производительность

Для edge-устройств:

Рекомендация: EmbeddingGemma-300M

- Минимальные требования к ресурсам

- On-device развертывание

- Хорошее качество для размера

💻 Практическое применение в 1C Neuro

Наша платформа использует передовые embedding-модели для:

1. RAG-система для кода 1С

# Индексация базы знаний 1С

from qdrant_client import QdrantClient

from sentence_transformers import SentenceTransformer

model = SentenceTransformer("Alibaba-NLP/gte-Qwen3-embedding-4B")

client = QdrantClient(url="http://localhost:6333")

# Создание эмбеддингов для документации 1С

docs = load_1c_documentation()

embeddings = model.encode(docs, show_progress_bar=True)

# Загрузка в векторную БД

client.upload_collection(

collection_name="1c_knowledge_base",

vectors=embeddings,

payload=[{"text": doc, "source": "official_docs"} for doc in docs]

)2. Семантический поиск по коду

# Поиск похожих фрагментов кода

query = "Как правильно обработать ошибку при записи документа?"

query_vector = model.encode(query)

results = client.search(

collection_name="1c_knowledge_base",

query_vector=query_vector,

limit=5

)

for result in results:

print(f"Релевантность: {result.score:.2f}")

print(f"Ответ: {result.payload['text']}\n")3. Кластеризация обращений в поддержку

# Автоматическая группировка похожих вопросов

from sklearn.cluster import KMeans

support_tickets = load_support_tickets()

ticket_embeddings = model.encode(support_tickets)

# Кластеризация

kmeans = KMeans(n_clusters=10)

clusters = kmeans.fit_predict(ticket_embeddings)

# Анализ типичных проблем

for cluster_id in range(10):

cluster_tickets = [t for t, c in zip(support_tickets, clusters) if c == cluster_id]

print(f"Кластер {cluster_id}: {len(cluster_tickets)} обращений")🔧 Технические требования

Минимальные требования для запуска:

GigaEmbeddings / Qwen3-4B:

- GPU: 8GB VRAM (RTX 3070 / A10)

- RAM: 16GB

- Библиотеки: transformers ≥4.51.0, sentence-transformers ≥5.1.1

Для контекста >2048 токенов:

pip install flash-attnQwen3-8B:

- GPU: 16GB VRAM (RTX 4090 / A100)

- RAM: 32GB

🌟 Будущее embedding-моделей

Тренды 2026 года:

Matryoshka Representation Learning (MRL)

- Гибкое сжатие эмбеддингов без потери качества

- Экономия хранилища и ускорение поиска

Instruction-Aware Models

- Одна модель для всех задач

- Понимание естественных команд

Multimodal Embeddings

- Единое векторное пространство для текста, кода и изображений

- Кросс-модальный поиск

Specialized Domain Models

- Модели для конкретных отраслей (финтех, медицина, юриспруденция)

- Глубокое понимание предметной области

📚 Заключение

2026 год стал переломным для технологии эмбеддингов. Новое поколение моделей открывает невиданные ранее возможности:

- ✅ Обработка документов целиком (до 32K токенов)

- ✅ Качественная работа с русским языком

- ✅ Универсальность (одна модель — множество задач)

- ✅ Доступность (запуск на потребительском железе)

Для разработчиков 1С это означает новый уровень AI-ассистентов, способных глубоко понимать контекст и предоставлять действительно релевантные ответы.

1C Neuro уже интегрировал эти технологии, чтобы вы могли работать с самыми передовыми решениями в области AI для 1С!

Хотите узнать больше о том, как мы используем embedding-модели в 1C Neuro? Начните работу прямо сейчас!